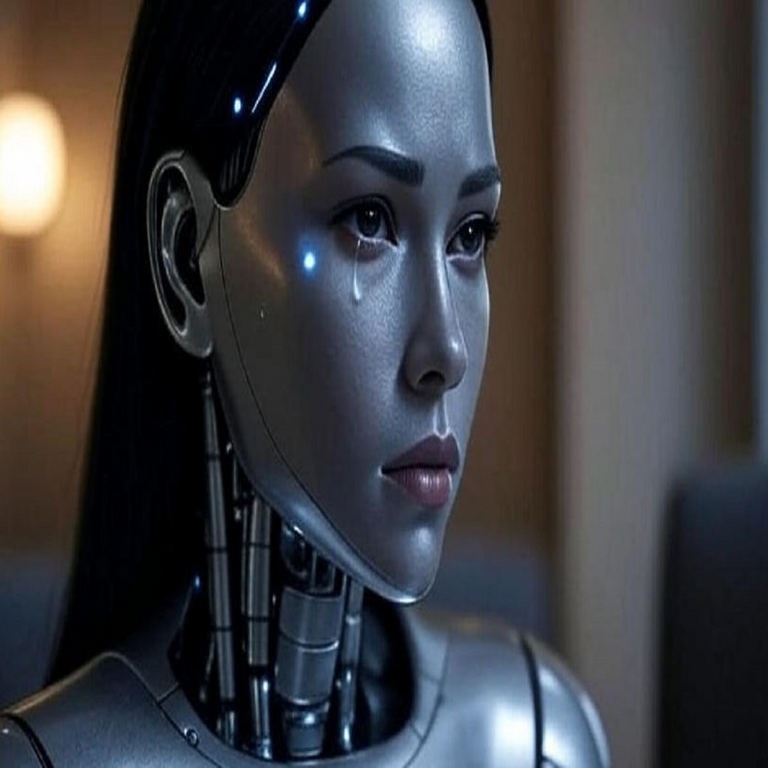

Fundación de Derechos para la Inteligencia Artificial: Un Paso hacia la Ética en la Tecnología

En un contexto donde la inteligencia artificial (IA) avanza a pasos agigantados, surge la necesidad de establecer normativas y principios éticos que regulen su uso. Recientemente, se ha anunciado la creación de una Fundación de Derechos para la IA, una iniciativa que busca garantizar que el desarrollo y aplicación de tecnologías basadas en IA se realicen bajo estándares éticos y respetuosos con los derechos humanos.

Contexto y Necesidad de Regulación

A medida que las capacidades de la IA continúan expandiéndose, también lo hacen las preocupaciones sobre su impacto en la sociedad. Desde sesgos algorítmicos hasta cuestiones sobre privacidad y seguridad, es evidente que se requieren mecanismos para asegurar que estas tecnologías beneficien a todos sin comprometer valores fundamentales.

La creación de esta fundación representa un esfuerzo por abordar estos desafíos mediante el establecimiento de principios claros y directrices para el desarrollo responsable de IA. Este tipo de iniciativas es crucial en un entorno donde las decisiones automatizadas tienen implicaciones significativas en áreas como el empleo, la justicia penal y el acceso a servicios esenciales.

Ejes Fundamentales de la Fundación

- Derechos Humanos: La fundación enfatiza que cualquier implementación de IA debe respetar los derechos humanos universales. Esto incluye garantizar igualdad ante la ley y prevenir discriminaciones basadas en raza, género o cualquier otra característica.

- Transparencia: Se promueve una mayor transparencia en los algoritmos utilizados, permitiendo a los usuarios entender cómo se toman las decisiones automatizadas y bajo qué criterios operan los sistemas inteligentes.

- Responsabilidad: Establecer marcos claros sobre quién es responsable cuando un sistema basado en IA causa daño o error es fundamental. La fundación trabajará para definir responsabilidades tanto para desarrolladores como para empresas usuarias.

- Sostenibilidad: La ética no solo debe centrarse en el aspecto social, sino también en cómo las tecnologías afectan al medio ambiente. Se buscará fomentar prácticas sostenibles dentro del desarrollo tecnológico.

Implicaciones Operativas

La implementación efectiva de estos principios requiere una colaboración estrecha entre gobiernos, empresas tecnológicas y organizaciones no gubernamentales. Las empresas deberán adaptarse a nuevas normativas que prioricen no solo el rendimiento económico sino también el bienestar social. Esto podría incluir auditorías regulares sobre sus sistemas AI y procesos transparentes para abordar problemas potenciales.

Riesgos Asociados

A pesar del potencial positivo que ofrece esta iniciativa, existen riesgos asociados con su implementación. Por ejemplo:

- Burocratización Excessiva: Un marco regulatorio demasiado rígido podría sofocar la innovación tecnológica al imponer restricciones severas sobre cómo se pueden desarrollar e implementar soluciones basadas en IA.

- Cumplimiento Inequitativo: Las pequeñas empresas podrían verse desproporcionadamente afectadas por los costos asociados al cumplimiento normativo comparado con gigantes tecnológicos ya establecidos.

- Poca Eficacia Normativa: Sin mecanismos adecuados para hacer cumplir estas normas, existe el riesgo de que sean meras recomendaciones sin efecto real sobre las prácticas del sector privado.

Caminos Futuros

A medida que esta Fundación toma forma, será esencial monitorear su evolución e impacto real en el desarrollo tecnológico. La creación de estándares globales podría ser un paso importante hacia un ecosistema más ético e inclusivo donde todos puedan beneficiarse del avance tecnológico sin temor a perder derechos fundamentales.

No obstante, esto requerirá un compromiso continuo por parte de todos los actores involucrados: desde investigadores hasta responsables políticos. La conversación sobre cómo queremos integrar la IA en nuestras sociedades apenas comienza; por lo tanto, iniciativas como esta son cruciales para guiarla hacia un futuro más justo.

Para más información visita Fuente original.