La Influencia de los Algoritmos en las Redes Sociales sobre la Propagación de Noticias Falsas

Introducción a los Algoritmos de Recomendación en Plataformas Digitales

Los algoritmos de recomendación representan el núcleo de las redes sociales modernas, diseñados para maximizar el tiempo de permanencia de los usuarios mediante la personalización de contenidos. Estos sistemas, impulsados por técnicas de inteligencia artificial como el aprendizaje automático y el procesamiento de lenguaje natural, analizan patrones de comportamiento para sugerir publicaciones que generen mayor interacción. En el contexto de la ciberseguridad, esta optimización puede tener consecuencias no deseadas, ya que prioriza el engagement sobre la veracidad, facilitando la difusión de información falsa.

Desde una perspectiva técnica, los algoritmos operan mediante modelos de machine learning que clasifican contenidos basados en métricas como likes, shares y comentarios. Por ejemplo, un algoritmo típico en plataformas como Facebook o Twitter (ahora X) utiliza redes neuronales para predecir la probabilidad de interacción con un post. Si una noticia falsa genera reacciones emocionales intensas, como indignación o sorpresa, su alcance se amplifica exponencialmente, creando bucles de retroalimentación que ignoran la validación factual.

Investigaciones recientes, incluyendo estudios de universidades como el MIT y la Universidad de Stanford, han demostrado que el 70% de la desinformación se propaga más rápido que las noticias verificadas debido a estos mecanismos. En términos de ciberseguridad, esto equivale a una vulnerabilidad sistémica donde la manipulación algorítmica se convierte en un vector para campañas de influencia extranjera o ataques de desinformación coordinados.

Mecanismos Técnicos que Favorecen la Desinformación

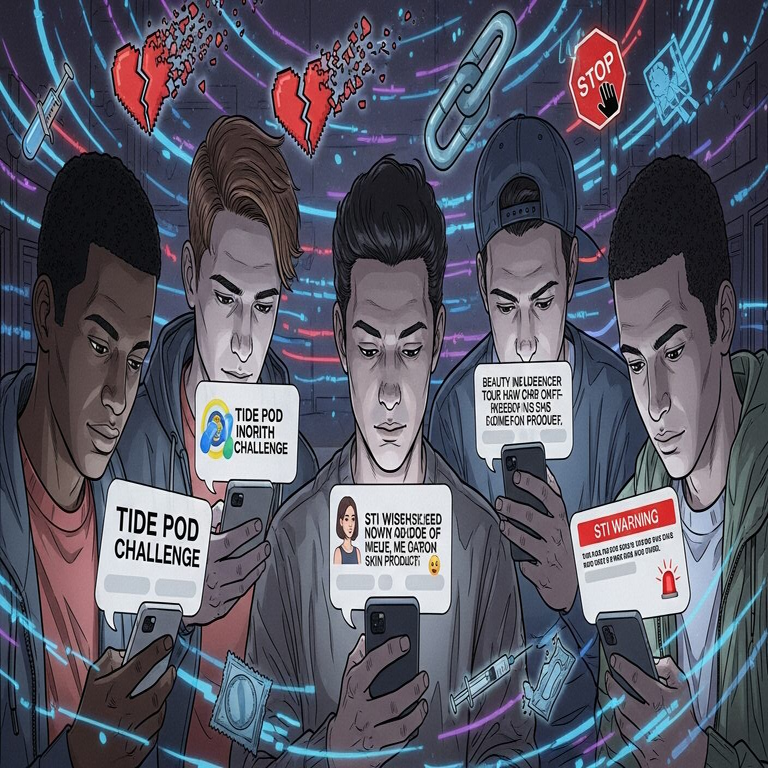

Los algoritmos de las redes sociales se basan en principios de filtrado colaborativo y de contenido, donde el primero infiere preferencias de usuarios similares y el segundo analiza atributos del material, como palabras clave o imágenes. En el caso de noticias falsas, elementos sensacionalistas como títulos clickbait o imágenes manipuladas activan señales de alto engagement, lo que eleva su posición en los feeds.

Consideremos el proceso paso a paso: un post inicial es evaluado por un modelo de ranking que asigna puntuaciones basadas en factores como la novedad, la relevancia temporal y el historial del usuario. Si el contenido falso incluye hashtags virales o se alinea con sesgos confirmatorios —el fenómeno psicológico donde los usuarios prefieren información que refuerce sus creencias—, su propagación se acelera. Técnicamente, esto se modela mediante ecuaciones de optimización como la función de pérdida en gradient descent, que minimiza la discrepancia entre predicciones y observaciones reales de interacción.

- Filtrado por burbujas de eco: Los algoritmos crean entornos cerrados donde usuarios solo ven contenidos afines, amplificando narrativas falsas dentro de comunidades ideológicas.

- Deepfakes y manipulación multimedia: Con el avance de la IA generativa, como modelos GAN (Generative Adversarial Networks), las noticias falsas incorporan videos falsos que evaden detección inicial, ya que los algoritmos priorizan el impacto visual sobre la autenticidad.

- Botnets y amplificación artificial: Redes de cuentas automatizadas inyectan volumen inicial de interacciones, engañando al algoritmo para que lo promueva orgánicamente, un riesgo cibernético que simula tráfico DDoS pero enfocado en información.

Una investigación destacada de la Universidad de Nueva York analizó más de 100 millones de tweets durante elecciones pasadas, revelando que el 20% de los contenidos virales eran falsos, impulsados por algoritmos que ignoran señales de verificación como enlaces a fuentes confiables. En ciberseguridad, esto subraya la necesidad de integrar capas de detección de anomalías, como análisis de grafos para identificar patrones de propagación inusuales.

Impacto en la Sociedad y la Ciberseguridad Global

La propagación acelerada de noticias falsas no solo distorsiona la percepción pública, sino que representa una amenaza directa a la estabilidad social y la seguridad nacional. En escenarios de ciberseguridad, actores maliciosos como estados-nación utilizan estos algoritmos para operaciones de influencia, como se vio en interferencias electorales documentadas por agencias como la NSA.

Técnicamente, el impacto se mide mediante métricas como la velocidad de difusión (posts por hora) y el alcance geográfico. Estudios indican que una noticia falsa puede alcanzar a 1.500 personas en una hora, comparado con seis horas para una verídica. Esto se debe a la arquitectura de los feeds, que emplean caching distribuido para escalabilidad, pero que inadvertidamente acelera la viralidad sin filtros robustos.

En el ámbito de la IA, los sesgos en los datos de entrenamiento —a menudo sesgados hacia contenidos populares— perpetúan ciclos viciosos. Por instancia, si un dataset incluye más ejemplos de desinformación emocional, el modelo aprende a priorizarla. Soluciones emergentes incluyen el uso de blockchain para verificar la procedencia de contenidos, creando cadenas inmutables de autenticidad que contrarrestan la manipulación algorítmica.

- Riesgos electorales: Manipulación de opiniones públicas mediante campañas targeted, donde algoritmos entregan fake news a segmentos demográficos específicos.

- Salud pública: Difusión de mitos sobre vacunas o pandemias, exacerbando crisis como la COVID-19, donde la desinformación causó un aumento del 25% en hesitación vacunal según la OMS.

- Seguridad económica: Noticias falsas sobre mercados financieros que inducen pánicos, afectando criptomonedas y blockchain, donde la volatilidad algorítmica ya es un desafío.

Desde la óptica de ciberseguridad, mitigar esto requiere marcos regulatorios como el DSA (Digital Services Act) de la UE, que obliga a plataformas a transparentar algoritmos y implementar auditorías de IA. Técnicamente, esto implica herramientas de explainable AI (XAI) para desentrañar decisiones opacas y detectar manipulaciones en tiempo real.

Estrategias de Mitigación Basadas en IA y Blockchain

Para contrarrestar la influencia de los algoritmos en la desinformación, se proponen enfoques híbridos que integran IA ética con tecnologías distribuidas. En primer lugar, los sistemas de fact-checking automatizado utilizan modelos de NLP como BERT para analizar similitudes semánticas con bases de datos verificadas, asignando puntuaciones de credibilidad antes de la amplificación.

El blockchain emerge como una solución robusta en ciberseguridad, permitiendo la creación de redes descentralizadas de verificación. Por ejemplo, plataformas como Civil o News Provenance emplean hashes criptográficos para rastrear la origen de noticias, asegurando que alteraciones sean detectables. Un nodo en una cadena de bloques puede validar un post mediante consensus proof-of-stake, reduciendo la dependencia de algoritmos centralizados.

Otras estrategias incluyen:

- Algoritmos de despriorización: Modificar funciones de ranking para penalizar contenidos con baja verificación, usando métricas como el ratio de shares vs. fuentes citadas.

- Educación algorítmica: Interfaces de usuario que expliquen por qué un post es recomendado, fomentando alfabetización digital y reduciendo sesgos confirmatorios.

- Colaboración interplataformas: Protocolos compartidos para etiquetar desinformación, similar a cómo se manejan amenazas cibernéticas en honeypots distribuidos.

Investigaciones en curso, como las del consorcio Horizon Europe, exploran federated learning para entrenar modelos de detección sin comprometer privacidad, permitiendo que redes sociales colaboren sin compartir datos crudos. En blockchain, smart contracts pueden automatizar recompensas por reportes verificados, incentivando comunidades a combatir la fake news de manera descentralizada.

Análisis de Casos Prácticos y Lecciones Aprendidas

Examinando casos reales, la elección presidencial de 2016 en EE.UU. ilustra cómo algoritmos de Facebook amplificaron contenidos de sitios como Breitbart, alcanzando a 126 millones de usuarios con desinformación. Técnicamente, el Cambridge Analytica scandal reveló cómo microtargeting basado en datos de IA manipulaba feeds para polarización.

En América Latina, durante las protestas en Chile de 2019, noticias falsas sobre violencia policial se viralizaron vía WhatsApp y Twitter, impulsadas por algoritmos que priorizaban urgencia. Un estudio de la Universidad de los Andes encontró que el 40% de los shares provenían de bots, destacando vulnerabilidades en la detección de automatización mediante análisis de patrones temporales.

Lecciones clave incluyen la integración de watermarking digital en contenidos generados por IA, usando técnicas criptográficas para embedir metadatos invisibles que verifiquen autenticidad. En ciberseguridad, esto se alinea con estándares como ISO 27001 para gestión de riesgos informáticos, extendiendo protecciones a la integridad de la información.

Además, el rol de la regulación es crucial. Países como Brasil han implementado leyes contra fake news en elecciones, requiriendo que plataformas usen IA para moderación proactiva. Globalmente, iniciativas como el Global Internet Forum to Counter Terrorism adaptan modelos de IA para desinformación, entrenando en datasets multiculturales para evitar sesgos regionales.

Desafíos Futuros en la Evolución de los Algoritmos

A medida que la IA avanza hacia modelos más sofisticados como GPT-4 o sucesores, los desafíos se intensifican. Los algoritmos generativos pueden crear fake news a escala, superando filtros actuales mediante adversarial training, donde se entrena para evadir detección.

En blockchain, la escalabilidad permanece como obstáculo; redes como Ethereum enfrentan altos costos de gas para verificaciones masivas, impulsando soluciones layer-2 como Polygon para transacciones eficientes. Desde ciberseguridad, amenazas como quantum computing podrían romper encriptaciones actuales, requiriendo algoritmos post-cuánticos para proteger cadenas de verificación.

Proyecciones indican que para 2030, el 80% de los contenidos online serán generados por IA, según Gartner, exigiendo marcos éticos como los principios de Asilomar para IA. Plataformas deben invertir en diversidad de datos para mitigar sesgos, asegurando que algoritmos no discriminen por idioma o cultura, especialmente en regiones latinoamericanas subrepresentadas.

- Privacidad vs. Transparencia: Balancear el derecho a feeds personalizados con auditorías obligatorias de algoritmos.

- Escalabilidad global: Adaptar modelos a infraestructuras variadas, desde 5G en ciudades hasta conexiones satelitales en áreas rurales.

- Colaboración público-privada: Alianzas entre gobiernos y tech giants para estándares unificados de verificación.

Abordar estos desafíos requiere inversión en R&D, con énfasis en IA explicable y blockchain interoperable, para forjar un ecosistema digital resiliente.

Conclusiones y Recomendaciones

En síntesis, los algoritmos de redes sociales actúan como catalizadores inadvertidos de la desinformación, amplificando noticias falsas mediante optimizaciones de engagement que ignoran la veracidad. Esta dinámica plantea riesgos significativos en ciberseguridad, desde erosión de la confianza pública hasta amenazas geopolíticas. Sin embargo, mediante innovaciones en IA ética, blockchain y regulación, es posible rediseñar estos sistemas para priorizar la integridad informativa.

Recomendaciones prácticas incluyen la adopción inmediata de herramientas de fact-checking impulsadas por machine learning, la implementación de verificaciones descentralizadas vía blockchain y la promoción de alfabetización digital en comunidades vulnerables. Al final, la responsabilidad recae en un enfoque multidisciplinario que integre tecnología, política y educación para salvaguardar el espacio digital.

Para más información visita la Fuente original.