Optimización de Recursos en GPUs mediante Batching Continuo en Inferencia de Inteligencia Artificial

Introducción al Batching en Procesos de Inferencia

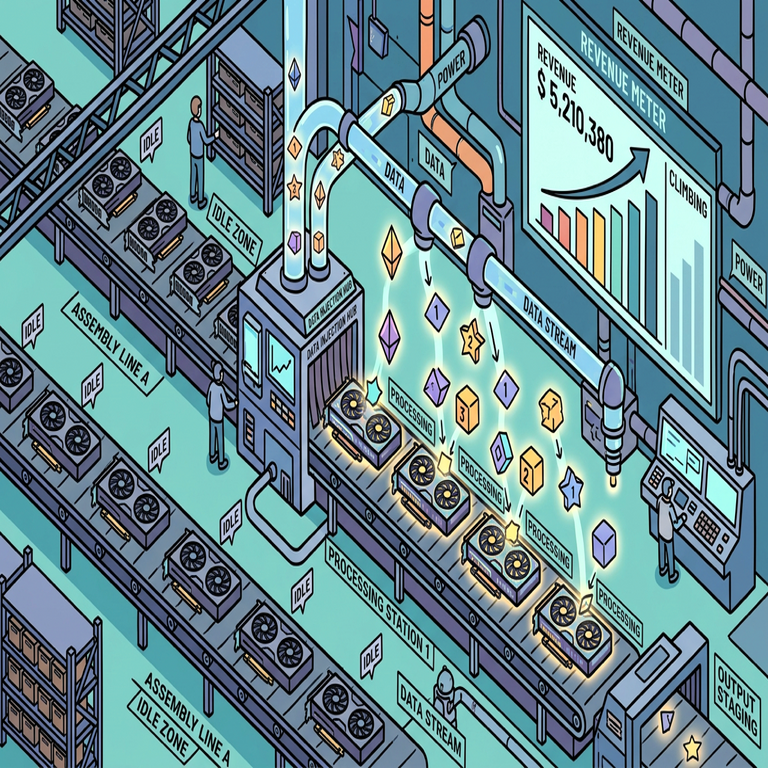

En el ámbito de la inteligencia artificial, particularmente en el procesamiento de modelos de lenguaje grandes (LLM, por sus siglas en inglés), la eficiencia en el uso de recursos computacionales representa un desafío crítico. Las unidades de procesamiento gráfico (GPUs) son componentes esenciales para acelerar las tareas de inferencia, donde se generan respuestas basadas en entradas de usuarios. Sin embargo, en entornos de producción, las GPUs a menudo permanecen inactivas mientras esperan la llegada de nuevas solicitudes o la finalización de lotes completos. Esta ineficiencia surge del enfoque tradicional de batching estático, que agrupa solicitudes en lotes fijos antes de procesarlos, lo que puede generar demoras significativas en la latencia y subutilización del hardware.

El batching continuo emerge como una solución innovadora para mitigar estos problemas. Esta técnica permite la integración dinámica de nuevas solicitudes en un lote en curso, sin interrumpir el procesamiento actual. De esta manera, se maximiza el throughput —la cantidad de solicitudes procesadas por unidad de tiempo— y se reduce el tiempo de espera para los usuarios finales. En contextos de aplicaciones en tiempo real, como chatbots o sistemas de recomendación, esta optimización resulta indispensable para mantener un rendimiento escalable y responsive.

Los desarrolladores detrás de esta metodología destacan que las GPUs inactivas representan una pérdida económica y operativa considerable, especialmente en infraestructuras en la nube donde los costos se calculan por hora de uso. Al implementar batching continuo, las organizaciones pueden lograr un mejor retorno de inversión en su hardware de alto rendimiento, alineándose con las demandas crecientes de la IA generativa.

Fundamentos Técnicos del Batching Continuo

Para comprender el batching continuo, es necesario revisar los principios subyacentes del procesamiento en lotes en inferencia de IA. En un escenario típico, la inferencia de un LLM involucra la generación token por token de una secuencia de salida. Cada token requiere cálculos matriciales intensivos, como multiplicaciones de matrices y activaciones softmax, que se benefician enormemente de la paralelización en GPUs.

En el batching estático, se acumulan múltiples solicitudes hasta formar un lote de tamaño óptimo —generalmente definido por la capacidad de memoria de la GPU— y luego se procesan de manera secuencial. Una vez que un lote se completa, la GPU entra en un estado de inactividad hasta que se forme el siguiente. Este enfoque, aunque eficiente para cargas de trabajo predecibles, falla en entornos con tráfico variable, donde las solicitudes llegan de forma asincrónica.

El batching continuo, por contraste, opera en un bucle continuo de procesamiento. Utiliza estructuras de datos como colas de prioridad o buffers dinámicos para insertar nuevas solicitudes en el lote actual sin pausar la ejecución. Esto se logra mediante la segmentación del proceso de inferencia en etapas: la fase de prefetching carga datos anticipadamente, mientras que la fase de decoding permite la actualización incremental del estado del modelo. Técnicamente, se basa en optimizaciones como la atención en caché (KV cache), que almacena los valores clave-valor de tokens previos para evitar recomputaciones costosas.

Una implementación clave es el framework vLLM, desarrollado por investigadores de la Universidad de California en Berkeley. vLLM emplea un motor de paginación para gestionar la memoria de manera eficiente, dividiendo el KV cache en páginas de tamaño fijo que se asignan y liberan dinámicamente. Esto previene la fragmentación de memoria y permite que lotes de tamaños variables coexistan sin exceder los límites de VRAM (memoria de video). En pruebas, vLLM ha demostrado mejoras de hasta un 24% en throughput comparado con sistemas como Hugging Face Transformers.

- Componentes principales: Incluye un scheduler que prioriza solicitudes basadas en métricas como longitud de secuencia o tiempo de llegada.

- Gestión de memoria: Utiliza algoritmos de reemplazo de páginas similares a los de sistemas operativos para evictar ítems menos prioritarios.

- Paralelismo: Soporta tensor parallelism y pipeline parallelism para distribuir cargas en múltiples GPUs.

Desde una perspectiva de ciberseguridad, esta técnica también introduce consideraciones sobre la integridad de datos en lotes mixtos. Es crucial implementar mecanismos de aislamiento para prevenir que solicitudes maliciosas interfieran con otras, como mediante encriptación de entradas o validación de tokens en el scheduler.

Beneficios Operativos y de Rendimiento

La adopción de batching continuo transforma la eficiencia de las infraestructuras de IA. En primer lugar, reduce la latencia end-to-end, que es el tiempo total desde la recepción de una solicitud hasta la entrega de la respuesta. En escenarios con tráfico bursty —picos irregulares de uso—, el batching estático puede acumular colas largas, incrementando la latencia en órdenes de magnitud. Con batching continuo, las solicitudes se procesan casi inmediatamente al llegar, manteniendo tiempos de respuesta por debajo de los 100 milisegundos en muchos casos.

En términos de throughput, los gains son notables. Estudios indican que esta aproximación puede elevar la tasa de tokens generados por segundo en un 2x a 4x, dependiendo del modelo y la carga de trabajo. Por ejemplo, para un modelo como Llama 2 de 70B parámetros, vLLM logra procesar más de 10,000 tokens por segundo en una sola GPU A100, comparado con los 3,000 tokens de enfoques tradicionales.

Desde el punto de vista económico, minimizar el tiempo idle de GPUs es crucial. En proveedores como AWS o Google Cloud, una GPU H100 cuesta alrededor de 5 dólares por hora. Si una GPU está idle el 50% del tiempo, se desperdician recursos equivalentes a miles de dólares mensuales. El batching continuo asegura un utilization rate superior al 90%, optimizando costos en entornos de producción a gran escala.

Adicionalmente, esta técnica facilita la escalabilidad horizontal. Al procesar lotes dinámicos, los clusters de GPUs pueden manejar variaciones en la demanda sin reprovisionamiento manual, integrándose bien con orquestadores como Kubernetes. En aplicaciones de blockchain e IA, como nodos de validación que ejecutan inferencia para contratos inteligentes, esta eficiencia reduce la latencia en transacciones, mejorando la usabilidad de redes descentralizadas.

- Mejora en latencia: Reducción promedio del 50% en tiempos de primera token (TTFT).

- Aumento en throughput: Hasta 4x en benchmarks estandarizados como ShareGPT.

- Eficiencia energética: Menor consumo por solicitud al maximizar el uso de hardware.

En el contexto de tecnologías emergentes, el batching continuo se alinea con avances en hardware como las GPUs de próxima generación de NVIDIA, que incorporan tensor cores optimizados para inferencia continua. Esto no solo acelera el procesamiento, sino que también reduce el footprint de carbono de las operaciones de IA, un factor cada vez más relevante en regulaciones ambientales.

Desafíos y Consideraciones de Implementación

A pesar de sus ventajas, implementar batching continuo presenta desafíos técnicos. Uno principal es la gestión de la memoria KV cache, que crece linealmente con la longitud de las secuencias. En lotes dinámicos, el riesgo de overflow es alto, requiriendo algoritmos sofisticados de compresión o eviction. Por instancia, técnicas como PagedAttention en vLLM dividen el cache en bloques no contiguos, pero demandan overhead en el acceso a memoria, potencialmente afectando el rendimiento en GPUs con ancho de banda limitado.

Otro reto es la consistencia en la generación de tokens. Al insertar solicitudes nuevas en un lote en curso, se debe asegurar que el estado del modelo permanezca coherente, evitando artefactos como repeticiones o incoherencias semánticas. Esto se resuelve mediante sincronización cuidadosa en el decoding loop, pero incrementa la complejidad del código.

Desde la perspectiva de ciberseguridad, el batching continuo amplifica riesgos como ataques de denegación de servicio (DoS) distribuidos, donde un flujo masivo de solicitudes pequeñas satura el scheduler. Mitigaciones incluyen rate limiting por IP, autenticación de solicitudes y monitoreo en tiempo real con herramientas como Prometheus. En entornos de IA sensible, como aquellos integrados con blockchain para verificación de datos, es esencial auditar el flujo de lotes para prevenir fugas de información confidencial.

La integración con frameworks existentes también requiere esfuerzo. Por ejemplo, adaptar modelos de Hugging Face a vLLM involucra conversiones de formato y tuning de hiperparámetros. En clusters distribuidos, la latencia de red entre GPUs puede bottleneck el proceso, necesitando optimizaciones como RDMA (Remote Direct Memory Access) para comunicaciones eficientes.

- Gestión de memoria: Riesgo de OOM (Out of Memory) en secuencias largas; solución: compresión de cache.

- Seguridad: Vulnerabilidades a inyecciones en lotes mixtos; solución: sandboxing por solicitud.

- Escalabilidad: Overhead en scheduling para miles de solicitudes concurrentes.

Los equipos de desarrollo recomiendan comenzar con pruebas en entornos controlados, utilizando benchmarks como MLPerf para validar el rendimiento antes de deployment en producción.

Aplicaciones Prácticas en Ciberseguridad e IA

El batching continuo encuentra aplicaciones directas en dominios como la ciberseguridad, donde la inferencia rápida es vital para detección de amenazas en tiempo real. Por ejemplo, sistemas de análisis de logs que emplean LLMs para identificar patrones anómalos en tráfico de red pueden procesar volúmenes masivos de datos sin demoras, mejorando la respuesta a incidentes.

En inteligencia artificial aplicada a blockchain, esta técnica optimiza nodos que ejecutan inferencia para oráculos descentralizados. Al reducir el tiempo idle, se acelera la validación de datos off-chain, fortaleciendo la seguridad de smart contracts contra manipulaciones. Proyectos como Chainlink podrían beneficiarse, integrando batching continuo para manejar consultas de precio en lotes dinámicos.

Otras aplicaciones incluyen asistentes virtuales en entornos empresariales, donde la privacidad de datos es paramount. Al procesar solicitudes en lotes aislados, se minimiza el riesgo de exposición cruzada, alineándose con estándares como GDPR o HIPAA.

En investigación, el batching continuo habilita experimentos a escala con datasets grandes, permitiendo iteraciones rápidas en el fine-tuning de modelos. Esto acelera avances en áreas como IA multimodal, donde se combinan texto, imagen y audio en inferencias continuas.

Perspectivas Futuras y Evolución Tecnológica

El futuro del batching continuo se ve prometedor con la convergencia de hardware y software. Próximas GPUs como la serie Blackwell de NVIDIA incorporarán aceleradores dedicados para inferencia dinámica, reduciendo aún más el overhead de scheduling. En paralelo, frameworks open-source como TensorRT-LLM están extendiendo soporte para batching continuo, democratizando su acceso.

En el ecosistema de IA, se espera integración con edge computing, donde GPUs embebidas en dispositivos IoT procesan inferencias locales con batching eficiente. Esto es particularmente relevante para ciberseguridad en redes 5G, donde la latencia baja es esencial para detección de intrusiones en tiempo real.

Respecto a blockchain, el batching continuo podría potenciar DAOs (Organizaciones Autónomas Descentralizadas) que utilizan IA para gobernanza, procesando propuestas de miembros en lotes dinámicos para votaciones eficientes. Sin embargo, desafíos éticos como el bias en scheduling —donde solicitudes prioritarias podrían amplificar desigualdades— deben abordarse mediante políticas de fairness en el algoritmo.

En resumen, esta tecnología no solo optimiza recursos, sino que redefine la viabilidad económica y operativa de la IA a escala. Su adopción generalizada impulsará innovaciones en múltiples sectores, desde ciberseguridad hasta finanzas descentralizadas.

Conclusión: Hacia una Inferencia Eficiente y Sostenible

El batching continuo representa un avance pivotal en la optimización de GPUs para inferencia de IA, eliminando ineficiencias inherentes a métodos tradicionales y habilitando despliegues más robustos. Al maximizar el uso de hardware, reduce costos, mejora el rendimiento y fortalece la resiliencia en entornos críticos. Para organizaciones que buscan escalar aplicaciones de IA, integrar esta técnica es un paso estratégico esencial, pavimentando el camino para innovaciones futuras en ciberseguridad, blockchain y más allá.

Para más información visita la Fuente original.