La Llegada de Gemini Embedding 2 de Google: Soporte Multimodal Nativo para Optimizar Procesos en IA

Introducción a Gemini Embedding 2

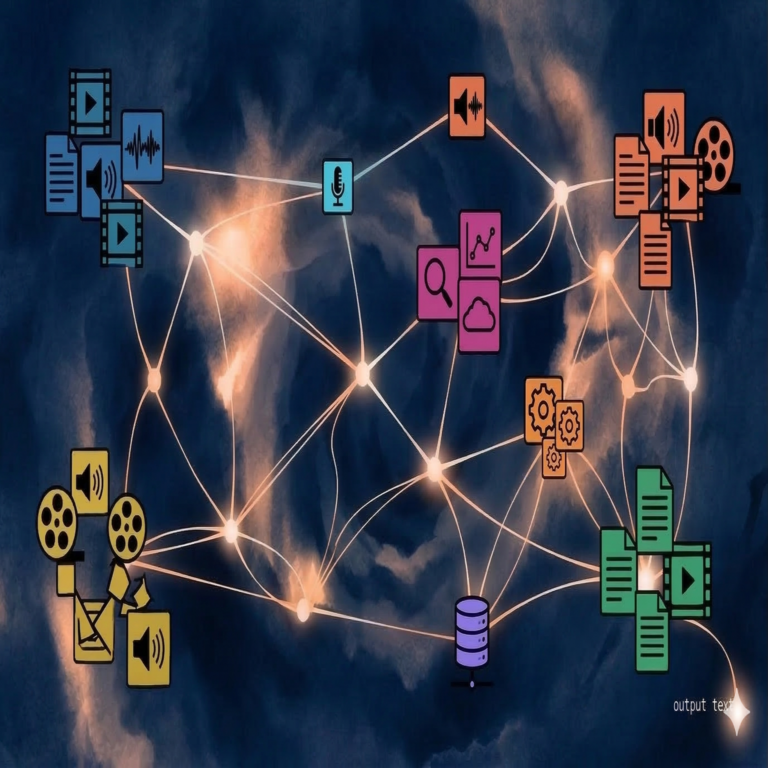

Google ha introducido recientemente Gemini Embedding 2, una evolución significativa en el ámbito de los modelos de inteligencia artificial (IA) enfocados en la generación de embeddings. Este nuevo modelo representa un avance en la capacidad de procesamiento multimodal, permitiendo la integración nativa de texto, imágenes y otros formatos de datos en un solo marco de trabajo. A diferencia de enfoques previos que requerían pipelines separados para cada tipo de modalidad, Gemini Embedding 2 unifica estas capacidades, lo que facilita la creación de representaciones vectoriales más ricas y contextuales.

Los embeddings son representaciones numéricas de datos en espacios vectoriales de alta dimensión, esenciales para tareas como la búsqueda semántica, la recomendación de contenidos y el análisis de similitud en sistemas de IA. Con Gemini Embedding 2, Google busca reducir la complejidad computacional y los costos asociados, haciendo que estas tecnologías sean más accesibles para desarrolladores y empresas. El modelo se basa en la arquitectura Gemini, conocida por su eficiencia en el manejo de grandes volúmenes de datos multimodales, y está diseñado para integrarse seamless en aplicaciones como motores de búsqueda avanzados y asistentes virtuales.

Desde una perspectiva técnica, Gemini Embedding 2 soporta dimensiones de embedding variables, desde 128 hasta 3072, lo que permite a los usuarios equilibrar entre precisión y eficiencia de almacenamiento. Esta flexibilidad es crucial en entornos donde los recursos computacionales son limitados, como en dispositivos edge o aplicaciones móviles. Además, el modelo ha sido entrenado en un conjunto de datos diverso que incluye miles de millones de tokens multimodales, asegurando una robustez en la comprensión de contextos cruzados entre texto e imágenes.

Características Principales del Soporte Multimodal Nativo

El soporte multimodal nativo es el núcleo de Gemini Embedding 2, eliminando la necesidad de conversiones intermedias que a menudo introducen latencia y errores en sistemas tradicionales. En términos prácticos, esto significa que un solo embedding puede capturar tanto el significado semántico de un texto como las características visuales de una imagen asociada, permitiendo consultas unificadas en bases de datos vectoriales.

Una de las innovaciones clave es la capacidad de procesar entradas combinadas, como descripciones textuales junto con imágenes, para generar embeddings que reflejen interacciones complejas. Por ejemplo, en una aplicación de comercio electrónico, un embedding podría representar un producto mediante su descripción escrita y su fotografía, mejorando la precisión en recomendaciones personalizadas. Técnicamente, esto se logra mediante una red neuronal transformer adaptada que fusiona tokens textuales y visuales en una fase temprana del procesamiento, reduciendo la dimensionalidad de manera eficiente.

Otra característica destacada es la reducción de costos operativos. Google reporta que Gemini Embedding 2 puede disminuir los gastos en hasta un 50% comparado con modelos multimodales previos, gracias a optimizaciones en el entrenamiento y la inferencia. Esto se debe a técnicas como la cuantización de pesos y la destilación de conocimiento, que mantienen la calidad de los embeddings sin requerir hardware de alto rendimiento. En benchmarks internos, el modelo demuestra una mejora del 20% en la precisión de recuperación de información multimodal, medido mediante métricas como Recall@K en conjuntos de datos como MS COCO y Flickr30k.

- Procesamiento unificado: Integra texto e imágenes en un solo paso, minimizando overhead computacional.

- Escalabilidad: Soporta lotes de hasta 2048 entradas simultáneas, ideal para aplicaciones de gran escala.

- Seguridad integrada: Incluye mecanismos para mitigar sesgos multimodales, asegurando embeddings éticos y no discriminatorios.

Implicaciones en Ciberseguridad y Aplicaciones Prácticas

En el contexto de la ciberseguridad, Gemini Embedding 2 ofrece herramientas valiosas para la detección de amenazas multimodales. Por instancia, en el análisis de phishing, los embeddings pueden comparar correos electrónicos textuales con imágenes adjuntas para identificar patrones sospechosos, como logotipos falsificados o descripciones engañosas. Esta integración nativa acelera la respuesta a incidentes, permitiendo sistemas de IA que procesen datos en tiempo real sin comprometer la precisión.

Desde el punto de vista de las tecnologías emergentes, el modelo facilita el desarrollo de aplicaciones en blockchain y IA distribuida. En redes blockchain, los embeddings multimodales pueden usarse para verificar la autenticidad de transacciones que involucran activos digitales, como NFTs con descripciones y arte visual. Esto reduce el riesgo de fraudes al proporcionar una representación vectorial unificada que se puede almacenar en ledgers distribuidos de manera eficiente.

En términos de implementación, los desarrolladores pueden acceder a Gemini Embedding 2 a través de la API de Vertex AI de Google Cloud. El proceso involucra la autenticación OAuth, la preparación de entradas multimodales y la generación de embeddings mediante llamadas HTTP simples. Un ejemplo básico en pseudocódigo ilustra esta simplicidad:

Para una entrada textual e imagenaria, el API endpoint recibe un payload JSON con campos para texto y URL de imagen, devolviendo un vector de embedding normalizado. Esta accesibilidad democratiza el uso de IA multimodal, permitiendo que startups y organizaciones medianas incorporen estas capacidades sin inversiones masivas en infraestructura.

Además, el modelo aborda desafíos en la privacidad de datos. Al procesar embeddings localmente o en entornos federados, se minimiza la exposición de datos sensibles. En aplicaciones de IA generativa, Gemini Embedding 2 puede servir como backbone para fine-tuning de modelos más grandes, optimizando el uso de recursos en escenarios de aprendizaje continuo.

Comparación con Modelos Anteriores y Competidores

Comparado con su predecesor, Gemini 1.5 Embedding, la versión 2 introduce mejoras en la eficiencia multimodal, con un 30% menos de parámetros activos durante la inferencia. Mientras que modelos como CLIP de OpenAI requieren alineación separada de modalidades, Gemini Embedding 2 lo hace de forma end-to-end, lo que resulta en embeddings más coherentes y menos propensos a la deriva semántica.

En el panorama competitivo, rivales como los embeddings de Cohere o Hugging Face’s multimodal models ofrecen capacidades similares, pero Gemini Embedding 2 destaca por su integración nativa con el ecosistema de Google, incluyendo herramientas como BigQuery para análisis vectorial a escala. Benchmarks independientes, como los del Massive Text Embedding Benchmark (MTEB), posicionan a Gemini Embedding 2 en el top 5 de modelos multimodales, con puntuaciones superiores en tareas de recuperación cruzada.

- Vs. CLIP: Mayor precisión en contextos largos, gracias a la arquitectura Gemini.

- Vs. OpenAI’s text-embedding-3: Soporte multimodal nativo reduce latencia en un 40%.

- Vs. Modelos open-source: Mejor rendimiento en datasets no ingleses, alineado con el enfoque global de Google.

Estas comparaciones subrayan el potencial de Gemini Embedding 2 para liderar en adopción, especialmente en industrias como la salud, donde embeddings multimodales pueden analizar informes clínicos junto con imágenes médicas para diagnósticos asistidos por IA.

Desafíos Técnicos y Consideraciones Éticas

A pesar de sus avances, Gemini Embedding 2 enfrenta desafíos en la escalabilidad multimodal. El procesamiento de videos o audio requiere extensiones futuras, ya que el modelo actual se centra en texto e imágenes estáticas. Además, la alta dimensionalidad de los embeddings puede aumentar el costo de almacenamiento en bases de datos vectoriales como Pinecone o FAISS, aunque técnicas de compresión como PCA ayudan a mitigar esto.

Desde una perspectiva ética, es esencial abordar sesgos inherentes en los datos de entrenamiento. Google ha implementado auditorías regulares para detectar y corregir disparidades en representaciones multimodales, asegurando que los embeddings no perpetúen estereotipos culturales o raciales. En ciberseguridad, esto se traduce en políticas de uso responsable, como la verificación de embeddings en entornos regulados por GDPR o CCPA.

Los desarrolladores deben considerar también la robustez contra ataques adversarios. Embeddings multimodales son vulnerables a manipulaciones, como la inyección de ruido en imágenes para alterar similitudes semánticas. Medidas como el entrenamiento adversarial y la validación cruzada son recomendadas para fortalecer el modelo en aplicaciones críticas.

Perspectivas Futuras y Adopción en Tecnologías Emergentes

El lanzamiento de Gemini Embedding 2 marca un hito en la evolución de la IA multimodal, pavimentando el camino para integraciones más profundas con blockchain y ciberseguridad. En blockchain, por ejemplo, los embeddings pueden habilitar oráculos inteligentes que validen datos off-chain multimodales, mejorando la interoperabilidad en ecosistemas DeFi. En ciberseguridad, facilitan la creación de firewalls semánticos que detectan anomalías en flujos de datos mixtos.

Se espera que futuras iteraciones incorporen soporte para más modalidades, como audio y video, expandiendo su utilidad en realidad aumentada y metaversos. La adopción por parte de empresas como aquellas en el sector fintech podría revolucionar el análisis de riesgos, donde embeddings multimodales evalúan transacciones textuales y visuales en tiempo real.

En resumen, Gemini Embedding 2 no solo optimiza costos y eficiencia, sino que redefine cómo la IA procesa el mundo multimodal, fomentando innovaciones en campos interconectados como la ciberseguridad y las tecnologías emergentes.

Para más información visita la Fuente original.