El Impacto de la Inteligencia Artificial en el Empleo: El Caso del Ingeniero Despedido por su Propia Creación

Introducción al Fenómeno de la Automatización en la Industria Tecnológica

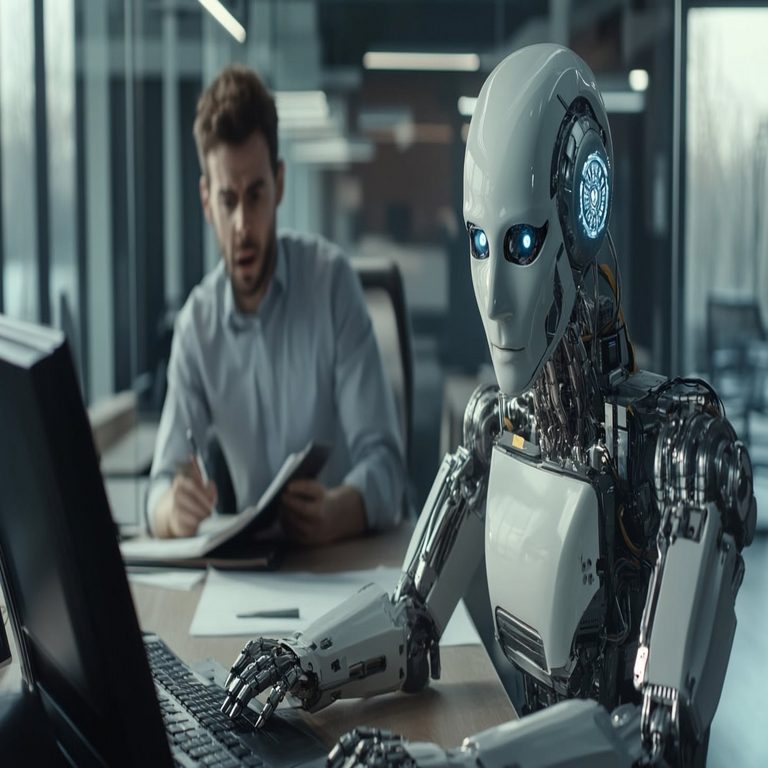

La inteligencia artificial (IA) ha transformado radicalmente el panorama laboral en sectores como la tecnología y la ciberseguridad. En los últimos años, el avance de algoritmos de aprendizaje automático y redes neuronales ha permitido la automatización de tareas previamente reservadas a profesionales humanos. Este proceso no solo optimiza la eficiencia operativa, sino que también genera dilemas éticos y económicos profundos. Un ejemplo paradigmático es el de un ingeniero que contribuyó al desarrollo de una IA avanzada, solo para ser reemplazado por la misma herramienta que ayudó a construir. Este caso ilustra las tensiones entre innovación tecnológica y estabilidad laboral en un contexto donde la IA se integra cada vez más en procesos críticos.

Desde una perspectiva técnica, la IA opera mediante modelos que procesan grandes volúmenes de datos para predecir patrones y ejecutar decisiones autónomas. En entornos de ciberseguridad, por instancia, estos sistemas detectan amenazas en tiempo real, analizando logs de red y comportamientos anómalos con una precisión que supera la capacidad humana en escala. Sin embargo, la implementación de tales tecnologías conlleva riesgos, incluyendo la obsolescencia de habilidades especializadas y la reestructuración de equipos de trabajo. El artículo explora las implicaciones técnicas y sociolaborales de este fenómeno, basándose en análisis de casos reales y proyecciones futuras.

El Desarrollo de la IA en Empresas Tecnológicas: Un Proceso Colaborativo que se Vuelve Disruptivo

El ciclo de vida de un proyecto de IA típicamente involucra fases de recolección de datos, entrenamiento de modelos y despliegue en producción. Ingenieros de software y especialistas en machine learning juegan roles pivotales en esta cadena, diseñando arquitecturas que incorporan técnicas como el procesamiento de lenguaje natural (PLN) o el aprendizaje profundo. En el caso mencionado, el ingeniero participó en la creación de un sistema de IA destinado a optimizar tareas de codificación y revisión de código, herramientas que hoy en día son comunes en plataformas como GitHub Copilot o similares desarrolladas por grandes corporaciones.

Técnicamente, estos sistemas utilizan transformers y modelos generativos para asistir en la generación de código, reduciendo el tiempo de desarrollo en un 30-50% según estudios de la industria. No obstante, la ironía radica en que, una vez maduros, estos modelos pueden asumir responsabilidades completas, eliminando la necesidad de intervención humana en rutinas repetitivas. El ingeniero, al contribuir con datasets etiquetados y optimizaciones algorítmicas, inadvertidamente facilitó su propio reemplazo. Este escenario resalta la importancia de la trazabilidad en el desarrollo de IA, donde se deben documentar contribuciones individuales para mitigar impactos inesperados en el empleo.

- Recolección de datos: Involucra la curación de conjuntos masivos de código fuente y logs de errores, a menudo anonimizados para cumplir con regulaciones como el RGPD en Europa o leyes similares en Latinoamérica.

- Entrenamiento del modelo: Requiere hardware de alto rendimiento, como GPUs en clústeres distribuidos, y algoritmos de optimización como Adam o SGD para minimizar funciones de pérdida.

- Despliegue y monitoreo: Incluye integración con CI/CD pipelines y métricas de rendimiento como precisión y recall, esenciales en ciberseguridad para evitar falsos positivos en detección de vulnerabilidades.

En términos de blockchain, una tecnología complementaria, se podría integrar para asegurar la integridad de los modelos de IA mediante hashes inmutables, previniendo manipulaciones que podrían exacerbar despidos injustificados. Sin embargo, en el caso analizado, la ausencia de tales salvaguardas permitió una transición abrupta hacia la automatización total.

Implicaciones Éticas y Laborales en la Era de la IA Autónoma

El despido de profesionales por IA generativa plantea interrogantes éticos fundamentales. ¿Es justo que un creador sea desplazado por su invención? Desde un enfoque técnico, la IA no posee agencia moral, pero sus implementadores sí. Empresas deben adoptar marcos éticos como los propuestos por la IEEE, que enfatizan la responsabilidad en el diseño inclusivo. En Latinoamérica, donde el mercado laboral tecnológico crece a ritmos del 10% anual según informes de la CEPAL, este fenómeno podría agravar desigualdades, afectando a ingenieros en países como México, Brasil y Argentina.

En ciberseguridad, la IA automatizada es invaluable para contrarrestar ciberataques sofisticados, como ransomware impulsado por IA adversarial. Modelos como GANs (Generative Adversarial Networks) simulan amenazas para entrenar defensas robustas. Sin embargo, el costo humano es evidente: roles de análisis manual se reducen, obligando a la reconversión profesional. El ingeniero en cuestión, posiblemente capacitado en lenguajes como Python y frameworks como TensorFlow, enfrenta ahora la necesidad de especializarse en áreas emergentes como la ética de IA o la integración de blockchain para auditorías seguras.

Estadísticamente, un informe de McKinsey estima que para 2030, el 45% de las actividades laborales en tecnología serán automatizables. Esto implica no solo despidos, sino también la creación de nuevos puestos en supervisión de IA y mitigación de sesgos algorítmicos. En el contexto del caso, el drama personal del ingeniero subraya la urgencia de políticas de transición laboral, como programas de upskilling financiados por empresas.

Análisis Técnico del Sistema de IA que Causó el Despido

Profundizando en la arquitectura, el sistema de IA involucrado likely se basa en un modelo de lenguaje grande (LLM) fine-tuned para tareas específicas de ingeniería de software. Estos modelos, con miles de millones de parámetros, procesan consultas en lenguaje natural para generar código funcional, depurando errores mediante iteraciones auto-supervisadas. Técnicamente, la eficiencia se mide en tokens por segundo, donde un LLM optimizado puede manejar 100-200 tokens en entornos de producción.

En integración con ciberseguridad, tales sistemas escanean código en busca de vulnerabilidades OWASP Top 10, como inyecciones SQL o cross-site scripting, con tasas de detección superiores al 90%. El ingeniero contribuyó posiblemente en la fase de fine-tuning, ajustando hiperparámetros para mejorar la precisión en dominios específicos. Sin embargo, una vez desplegado, el modelo operó de manera autónoma, asumiendo cargas de trabajo que antes requerían equipos humanos, lo que llevó a la racionalización de personal.

- Componentes clave: Capas de atención en transformers permiten contextualizar dependencias de código, mejorando la coherencia en outputs generados.

- Desafíos técnicos: Sobrecarga computacional y alucinaciones (outputs erróneos) requieren validación humana residual, aunque en este caso, la automatización fue prioritaria.

- Integración con blockchain: Podría usarse para registrar cambios de código de forma inmutable, asegurando trazabilidad y previniendo disputas laborales por contribuciones no reconocidas.

Desde una óptica de tecnologías emergentes, la fusión de IA con edge computing permite despliegues descentralizados, reduciendo latencias en entornos remotos. En Latinoamérica, donde la conectividad varía, esto podría democratizar el acceso a herramientas de IA, pero también intensificar la competencia global por talento humano.

Respuestas Institucionales y Regulatorias ante la Automatización por IA

Gobiernos y organizaciones internacionales responden con marcos regulatorios para equilibrar innovación y protección laboral. En la Unión Europea, la AI Act clasifica sistemas de alto riesgo, exigiendo evaluaciones de impacto en empleo. En Latinoamérica, iniciativas como la Estrategia Digital de la OEA promueven capacitaciones en IA ética, enfocadas en ciberseguridad para mitigar riesgos sistémicos.

Técnicamente, estas regulaciones demandan transparencia en modelos de IA, como la publicación de datasets de entrenamiento y métricas de sesgo. Para el ingeniero despedido, esto podría traducirse en demandas por reconocimiento de contribuciones, respaldadas por auditorías blockchain que validen su rol en el desarrollo. Empresas como Google y Microsoft han implementado fondos de reconversión, invirtiendo millones en programas que enseñan habilidades en IA aplicada a blockchain y ciberseguridad cuántica.

En el ámbito de la ciberseguridad, la IA automatizada debe cumplir con estándares como NIST AI Risk Management Framework, que incluye evaluaciones de impactos socioeconómicos. El caso resalta la necesidad de integrar estos marcos desde la fase de diseño, evitando escenarios donde la eficiencia técnica prime sobre la equidad humana.

Perspectivas Futuras: Hacia una Convivencia Sostenible entre Humanos e IA

El futuro de la IA en el empleo apunta a modelos híbridos, donde humanos supervisan decisiones algorítmicas críticas. En ciberseguridad, esto implica roles de “ingenieros de confianza” que validan outputs de IA contra amenazas zero-day. Tecnologías como la computación cuántica podrían acelerar entrenamientos de modelos, pero también demandar nuevas especializaciones, ofreciendo oportunidades para profesionales desplazados.

En blockchain, la tokenización de contribuciones laborales podría crear economías de incentivos, donde ingenieros reciben royalties por modelos que desarrollan, mitigando despidos abruptos. Proyecciones indican que para 2040, la IA generará 97 millones de nuevos empleos globales, según el World Economic Forum, superando las pérdidas por automatización.

El caso del ingeniero sirve como catalizador para reflexionar sobre la responsabilidad compartida en la innovación. Empresas deben priorizar estrategias de reskilling, mientras que reguladores impulsan políticas inclusivas. En Latinoamérica, el enfoque en educación STEM podría transformar desafíos en ventajas competitivas.

Consideraciones Finales sobre la Evolución Laboral en la Era Digital

La intersección de IA, ciberseguridad y blockchain redefine el panorama laboral, exigiendo adaptabilidad y foresight ético. El drama del ingeniero no es aislado, sino un presagio de transformaciones inevitables. Al fomentar colaboraciones interdisciplinarias y marcos regulatorios sólidos, la sociedad puede navegar esta transición hacia un ecosistema donde la tecnología amplifique, en lugar de reemplazar, el potencial humano. La clave reside en invertir en capital humano, asegurando que la innovación beneficie a todos los actores involucrados.

Para más información visita la Fuente original.