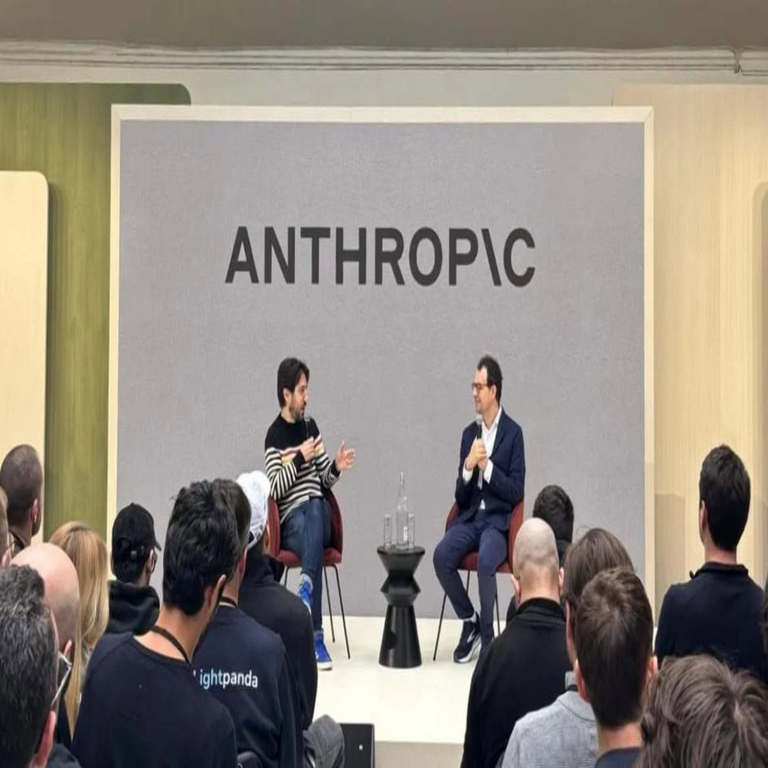

El Conflicto Ético entre Anthropic y el Departamento de Defensa: Implicaciones para la IA en Aplicaciones Militares

Introducción al Debate sobre IA y Seguridad Nacional

En el panorama actual de la inteligencia artificial, el desarrollo de tecnologías avanzadas no solo impulsa innovaciones en sectores civiles, sino que también genera tensiones en el ámbito militar. La reciente controversia entre Anthropic, una empresa líder en investigación de IA segura, y el Departamento de Defensa de Estados Unidos (DoD) destaca las complejidades éticas inherentes a la integración de la IA en sistemas de defensa. Este conflicto surge de la decisión de Anthropic de rechazar un contrato potencial con el DoD, motivada por preocupaciones sobre el uso de sus modelos de IA en el desarrollo de armas autónomas letales. Este episodio no es aislado, sino que refleja un debate más amplio sobre los límites morales y regulatorios de la IA en contextos de seguridad nacional.

La IA, con sus capacidades de procesamiento de datos masivos y toma de decisiones en tiempo real, representa un activo estratégico para las fuerzas armadas. Sin embargo, su aplicación en escenarios militares plantea riesgos significativos, como la pérdida de control humano en operaciones críticas y el potencial para escaladas no intencionales en conflictos. Anthropic, fundada por exinvestigadores de OpenAI, se posiciona como una entidad comprometida con la “IA alineada con valores humanos”, priorizando la seguridad y la transparencia sobre el lucro inmediato. Esta postura contrasta con las demandas del DoD, que busca acelerar la adopción de IA para mantener una ventaja tecnológica frente a adversarios globales.

El rechazo de Anthropic al contrato no solo subraya divisiones internas en la industria de la IA, sino que también invita a una reflexión profunda sobre cómo equilibrar la innovación con la responsabilidad ética. En un mundo donde potencias como China y Rusia avanzan rápidamente en IA militar, las decisiones de empresas privadas como Anthropic podrían influir en la configuración geopolítica futura.

Contexto Histórico de la IA en el Ámbito Militar

La intersección entre IA y defensa no es un fenómeno reciente. Desde la Guerra Fría, Estados Unidos ha invertido en tecnologías computacionales para superioridad militar, evolucionando de sistemas expertos en los años 80 a redes neuronales profundas en la era actual. Programas como el DARPA (Agencia de Proyectos de Investigación Avanzada de Defensa) han financiado investigaciones en IA durante décadas, culminando en iniciativas como el Proyecto Maven en 2017, que utilizó algoritmos de aprendizaje automático para analizar imágenes de drones en operaciones antiterroristas.

Sin embargo, el auge de modelos de lenguaje grandes (LLM) y sistemas generativos ha transformado el panorama. Estos modelos, capaces de razonar, planificar y generar contenido, ofrecen aplicaciones en inteligencia, logística y ciberdefensa. Por ejemplo, la IA puede procesar terabytes de datos de sensores en segundos, identificando patrones que humanos tardarían horas en detectar. No obstante, su despliegue en armas autónomas —sistemas que seleccionan y neutralizan objetivos sin intervención humana— genera alarma ética. Convenciones internacionales, como la Convención sobre Ciertas Armas Convencionales (CCW), discuten regulaciones, pero carecen de consenso vinculante.

Anthropic entra en este contexto con su enfoque en “IA constitucional”, un marco donde los modelos se entrenan con principios éticos predefinidos para evitar sesgos o comportamientos perjudiciales. Esta metodología, inspirada en la alineación de IA, contrasta con enfoques más utilitarios adoptados por otras firmas. El DoD, por su parte, ha establecido directrices como la Ética de la IA en el Departamento de Defensa (2020), que enfatizan la responsabilidad humana, pero críticos argumentan que estas son insuficientes para mitigar riesgos en escenarios de combate real.

Detalles del Conflicto entre Anthropic y el DoD

El epicentro del desacuerdo radica en un contrato propuesto por el DoD para integrar modelos de IA de Anthropic en sistemas de comando y control militar. Fuentes indican que el acuerdo involucraría el uso de Claude, el modelo insignia de Anthropic, en análisis de inteligencia y simulación de escenarios tácticos. Sin embargo, Anthropic declinó la oferta citando cláusulas que permitían el empleo de su tecnología en “aplicaciones letales autónomas”, violando sus políticas internas de no contribución a armas que operen sin supervisión humana.

Esta decisión fue pública en un memo interno filtrado, donde ejecutivos de Anthropic enfatizaron su compromiso con la “no proliferación de IA peligrosa”. El DoD, respondiendo a través de portavoces, defendió la necesidad de tales colaboraciones para contrarrestar amenazas asimétricas, argumentando que la IA ética puede reducir bajas civiles al mejorar la precisión de operaciones. No obstante, el rechazo ha generado repercusiones: el DoD ha redirigido fondos a competidores como Palantir y Anduril, que son más receptivos a contratos militares.

Desde una perspectiva técnica, los modelos de Anthropic, como Claude 3, destacan por su robustez en razonamiento multitarea y mitigación de alucinaciones —errores comunes en LLMs que podrían ser catastróficos en contextos militares—. Integrarlos en redes de sensores IoT o drones autónomos requeriría capas adicionales de verificación, como bucles de retroalimentación humana y auditorías de sesgo. Sin embargo, Anthropic argumenta que cualquier exposición a datos clasificados compromete su neutralidad, potencialmente exponiendo vulnerabilidades a adversarios cibernéticos.

- Aspectos técnicos clave del rechazo: Anthropic prioriza datasets de entrenamiento limpios y no militarizados para mantener la integridad de sus modelos.

- Implicaciones contractuales: El contrato incluía protecciones de propiedad intelectual, pero no garantías éticas absolutas, lo que generó desconfianza.

- Respuesta del DoD: Exploración de alternativas open-source o alianzas con startups de defensa, acelerando la fragmentación del ecosistema de IA.

Implicaciones Éticas y Regulatorias

El conflicto ilustra las tensiones entre innovación y ética en la IA. Desde el punto de vista ético, frameworks como el de la UNESCO sobre Ética de la IA (2021) abogan por principios de transparencia, justicia y no discriminación, aplicables a usos militares. En Latinoamérica, donde países como Brasil y México invierten en IA para defensa cibernética, este debate resuena: ¿deben las empresas regionales rechazar contratos similares para alinear con estándares globales?

Regulatoriamente, Estados Unidos carece de leyes específicas para IA militar, confiando en directivas ejecutivas. La propuesta de la Ley de IA Responsable (2023) busca establecer moratorias en armas autónomas letales, pero enfrenta oposición bipartidista. En contraste, la Unión Europea avanza con el AI Act, clasificando sistemas militares como de alto riesgo y exigiendo evaluaciones rigurosas. Este vacío legal en EE.UU. empuja a empresas como Anthropic a autoimponerse restricciones, potencialmente ralentizando el progreso nacional.

Además, el rechazo plantea cuestiones de soberanía tecnológica. Si firmas privadas dictan términos a agencias gubernamentales, ¿quién controla el desarrollo de IA crítica? En un escenario de carrera armamentística, la reticencia de Anthropic podría ceder terreno a competidores extranjeros, como los avances chinos en IA para vigilancia masiva.

Impactos Técnicos en el Desarrollo de IA Militar

Técnicamente, la exclusión de Anthropic obliga al DoD a recalibrar sus estrategias. Modelos alternativos, como GPT-4 de OpenAI (que ha colaborado previamente con defensa), ofrecen capacidades similares pero con menor énfasis en alineación constitucional. Esto podría resultar en sistemas menos robustos contra manipulaciones adversarias, como ataques de envenenamiento de datos.

En términos de arquitectura, la IA militar requiere integración con edge computing para operaciones en entornos desconectados. Por ejemplo, drones equipados con IA deben procesar video en tiempo real usando convoluciones neuronales, pero sin safeguards éticos, riesgos como falsos positivos en identificación de objetivos aumentan. Anthropic’s enfoque en interpretabilidad —haciendo que las decisiones de IA sean trazables— sería valioso, pero su ausencia acelera la adopción de black-box models, opacos y propensos a errores impredecibles.

Blockchain emerge como complemento potencial: su uso en cadenas de custodia para datos de IA militar asegura inmutabilidad y auditoría, mitigando preocupaciones de manipulación. Sin embargo, integrar blockchain con IA en defensa demanda expertise en criptografía post-cuántica, un área donde Anthropic ha contribuido indirectamente mediante investigaciones en seguridad.

- Ventajas técnicas de modelos alineados: Reducción de sesgos en análisis de inteligencia, mejorando la equidad en operaciones multinacionales.

- Desafíos sin colaboración: Aumento en costos de desarrollo y tiempo para validar alternativas éticas.

- Innovaciones emergentes: Híbridos de IA federada, donde modelos se entrenan descentralizadamente sin compartir datos sensibles.

Perspectivas Globales y Comparativas

A nivel global, el conflicto resalta disparidades en enfoques a la IA militar. China, a través de su Plan de Desarrollo de IA de Nueva Generación (2017), integra IA en todas las ramas del Ejército Popular de Liberación, priorizando velocidad sobre ética. Rusia, con sistemas como el tanque T-14 Armata equipado con IA, sigue un modelo similar. En contraste, naciones europeas como Francia y Alemania abogan por tratados internacionales contra armas autónomas, alineándose con posturas como la de Anthropic.

En Latinoamérica, el contexto es mixto. Países como Chile y Colombia exploran IA para ciberdefensa contra amenazas transnacionales, pero con presupuestos limitados, dependen de alianzas con EE.UU. El rechazo de Anthropic podría inspirar políticas regionales, como la Estrategia de IA de la OEA (2022), que enfatiza usos éticos y equitativos.

Comparativamente, el caso de Google en 2018 —retirándose del Proyecto Maven por protestas internas— prefigura el de Anthropic, demostrando que la presión ética de empleados y sociedad civil influye en decisiones corporativas. Esto sugiere una tendencia hacia “IA por diseño seguro”, donde ética se integra desde la fase de investigación.

Desafíos Futuros y Estrategias de Mitigación

Mirando hacia adelante, el conflicto acelera la necesidad de estándares unificados. Organizaciones como el Future of Life Institute proponen moratorias globales en IA letal, mientras que foros como el G7 discuten gobernanza. Para el DoD, estrategias incluyen invertir en IA open-source ética y fomentar colaboraciones con academia, reduciendo dependencia de firmas privadas reacias.

Anthropic, por su parte, podría expandir su influencia mediante publicaciones técnicas y advocacy, promoviendo benchmarks para IA segura en defensa no letal, como logística o entrenamiento simulado. En ciberseguridad, su expertise en adversarial robustness —resistencia a ataques— es crucial para proteger infraestructuras militares contra hacks de IA generativa.

Blockchain y IA convergen en soluciones híbridas: smart contracts para autorizaciones éticas en despliegues autónomos, asegurando cumplimiento normativo. Tecnologías emergentes como quantum-safe encryption protegen comunicaciones IA en entornos hostiles, abordando vulnerabilidades post-rechazo.

- Estrategias para el DoD: Diversificación de proveedores y énfasis en human-in-the-loop systems.

- Para Anthropic: Expansión a consultoría ética sin compromisos directos.

- Globalmente: Ratificación de protocolos como el de Lethal Autonomous Weapons en la ONU.

Cierre Reflexivo sobre el Horizonte de la IA Militar

El episodio entre Anthropic y el DoD marca un punto de inflexión en la evolución de la IA, donde decisiones corporativas moldean no solo tecnologías, sino trayectorias geopolíticas. Al priorizar ética sobre expansión inmediata, Anthropic redefine el rol de la industria privada en seguridad nacional, fomentando un ecosistema donde innovación y responsabilidad coexisten. Aunque el rechazo genera desafíos a corto plazo, a largo plazo podría catalizar regulaciones más robustas, asegurando que la IA militar sirva a la humanidad sin comprometer principios fundamentales.

Este desarrollo invita a la comunidad técnica a avanzar en soluciones integrales: desde algoritmos interpretables hasta marcos regulatorios inclusivos. En última instancia, el futuro de la IA en defensa dependerá de equilibrar poder con precaución, garantizando que la tecnología amplifique la inteligencia humana en lugar de suplantarla en momentos de crisis.

Para más información visita la Fuente original.