Evolución de los Filtros de Realidad Aumentada en Redes Sociales: Implicaciones Técnicas en Identidad Digital y Ciberseguridad

Introducción a los Filtros AR en Plataformas Digitales

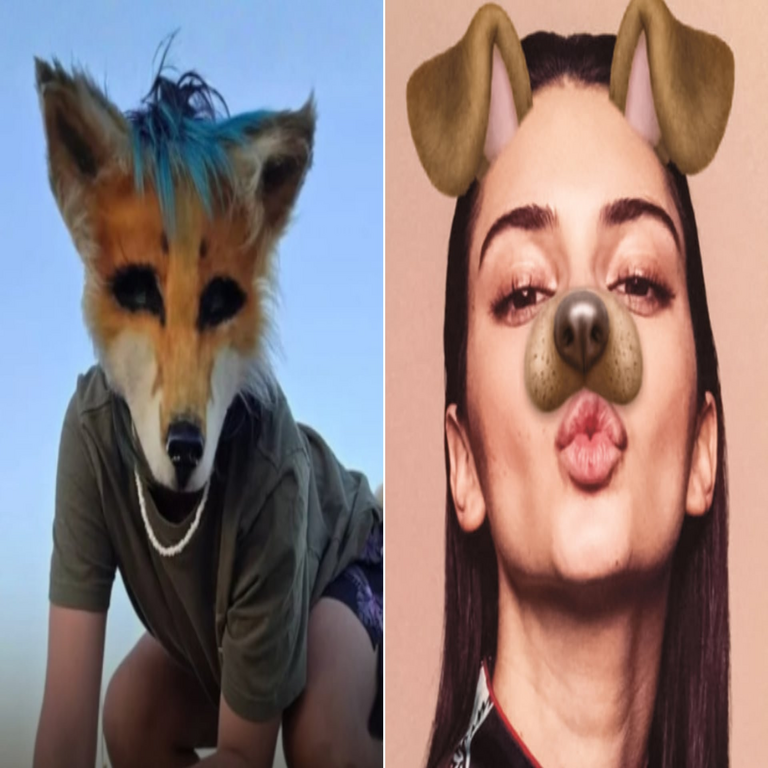

Los filtros de realidad aumentada (AR) han transformado la interacción en redes sociales, permitiendo a los usuarios superponer elementos virtuales sobre su imagen real en tiempo real. Antes de la emergencia de comunidades como los therians, que exploran identidades híbridas humano-animal, plataformas como Snapchat e Instagram ya ofrecían herramientas para adoptar apariencias de mascotas. Estos filtros no solo entretenían, sino que introdujeron avances en inteligencia artificial (IA) y procesamiento de imágenes, sentando bases para aplicaciones más complejas en ciberseguridad y privacidad digital.

Desde un punto de vista técnico, los filtros AR dependen de algoritmos de visión por computadora que detectan rasgos faciales y corporales mediante redes neuronales convolucionales (CNN). Estas redes analizan píxeles en flujos de video para mapear puntos clave, como ojos, nariz y boca, y luego aplican transformaciones geométricas para superponer orejas de gato o hocicos de perro. En entornos de redes sociales, este procesamiento ocurre en el lado del cliente o en servidores en la nube, optimizando latencia y consumo de recursos mediante técnicas como el aprendizaje federado, donde modelos se entrenan localmente para preservar datos sensibles.

La adopción temprana de estos filtros, alrededor de 2015 con Snapchat, coincidió con el auge de la IA accesible. Empresas como Meta y Snap Inc. invirtieron en SDK (Software Development Kits) como Lens Studio y Spark AR, que democratizaron el desarrollo de filtros. Estos kits integran bibliotecas de código abierto como OpenCV para detección de objetos y TensorFlow Lite para inferencia en dispositivos móviles, permitiendo a desarrolladores crear experiencias inmersivas sin requerir hardware especializado.

Tecnologías Subyacentes: IA y Visión por Computadora en Filtros de Mascotas

El núcleo de los filtros de mascotas radica en la segmentación semántica, un proceso donde la IA clasifica píxeles en categorías como “rostro humano” o “fondo”. Modelos como U-Net o Mask R-CNN, adaptados para AR, generan máscaras precisas que evitan distorsiones en movimientos rápidos. Por ejemplo, un filtro de “orejas de gato” en Instagram utiliza landmarks faciales (68 puntos estándar definidos por el modelo dlib) para anclar elementos virtuales, asegurando que se muevan sincronizadamente con la cabeza del usuario.

En términos de rendimiento, estos sistemas emplean optimizaciones como el seguimiento de partículas y el renderizado en GPU mediante Metal (iOS) o Vulkan (Android). La latencia típica es inferior a 30 milisegundos, crucial para una experiencia fluida. Además, la integración de machine learning permite personalización: algoritmos de recomendación, basados en collaborative filtering, sugieren filtros según interacciones previas, analizando metadatos como geolocalización y patrones de uso sin comprometer la privacidad mediante anonimización de datos.

- Detección facial: Emplea Haar cascades o modelos deep learning para identificar contornos en tiempo real.

- Superposición AR: Usa matrices de transformación homográfica para alinear elementos 3D con el plano de la cámara.

- Procesamiento en la nube: Para filtros complejos, como animaciones de colas virtuales, se recurre a APIs de AWS o Google Cloud, reduciendo carga en el dispositivo.

Estos avances no solo facilitaron la experimentación con identidades animales virtuales, sino que también pavimentaron el camino para aplicaciones en ciberseguridad, como la verificación biométrica disfrazada. En un contexto técnico, los filtros AR pueden integrarse con sistemas de autenticación multifactor, donde la detección de liveness (movimientos genuinos) previene suplantaciones mediante deepfakes.

Impacto en la Privacidad y Seguridad Digital

La proliferación de filtros AR en redes sociales plantea desafíos significativos en privacidad. Cada interacción genera datos biométricos implícitos, como mapas faciales, que se almacenan en perfiles de usuario. Plataformas como TikTok y Snapchat recolectan estos datos para mejorar modelos de IA, pero sin encriptación end-to-end, corren riesgo de brechas. Un ejemplo técnico es el uso de hashing salado para anonimizar rasgos, aunque vulnerabilidades como el side-channel attacks en bibliotecas de AR pueden exponer información.

Desde la perspectiva de ciberseguridad, los filtros introducen vectores de ataque. Malware disfrazado como apps de filtros puede explotar permisos de cámara para espiar, utilizando técnicas de inyección de código en JavaScript de AR. Investigaciones de firmas como Kaspersky destacan cómo actores maliciosos crean filtros falsos en tiendas de apps, inyectando payloads que roban datos de geolocalización o credenciales. Para mitigar esto, se recomiendan sandboxing en entornos AR y auditorías regulares de SDK mediante herramientas como OWASP ZAP.

En el ámbito de identidades digitales, estos filtros anticiparon debates sobre therians al normalizar alter egos virtuales. Técnicamente, esto se relaciona con zero-knowledge proofs en blockchain, donde usuarios prueban atributos (como “soy un gato virtual”) sin revelar datos subyacentes. Plataformas emergentes podrían integrar NFTs para avatares AR, asegurando ownership mediante contratos inteligentes en Ethereum, pero requiriendo wallets seguras para prevenir phishing.

- Riesgos de datos: Exposición de biometría a través de logs no encriptados.

- Ataques comunes: Man-in-the-middle en transmisiones de video AR.

- Medidas de protección: Uso de VPN y actualizaciones de firmware en dispositivos.

La regulación, como el GDPR en Europa o leyes similares en Latinoamérica, exige consentimiento explícito para procesamiento de AR, impulsando innovaciones como federated learning, donde modelos se entrenan sin centralizar datos sensibles.

Evolución Hacia Identidades Híbridas: Del Entretenimiento a lo Terapéutico

Antes de los therians, filtros de mascotas servían como escape lúdico, pero su base técnica en IA generativa abrió puertas a terapias digitales. Modelos como GANs (Generative Adversarial Networks) permiten crear avatares realistas de animales, usados en realidad virtual para tratar disforias de identidad. En redes sociales, esto se manifiesta en comunidades donde usuarios comparten sesiones AR, fomentando empatía mediante simulaciones inmersivas.

Técnicamente, la transición involucra multimodalidad: integración de audio y haptic feedback. Por instancia, un filtro de “perro” podría sincronizar ladridos generados por TTS (Text-to-Speech) con movimientos labiales detectados por IA. En blockchain, esto se extiende a DAOs (Decentralized Autonomous Organizations) para comunidades therian, donde smart contracts gestionan accesos a contenido AR exclusivo, asegurando descentralización y resistencia a censura.

En ciberseguridad, esta evolución exige robustez contra deepfakes avanzados. Herramientas como Microsoft’s Video Authenticator analizan artefactos en filtros AR para detectar manipulaciones, empleando espectrogramas y análisis de inconsistencias en iluminación. Para usuarios en Latinoamérica, donde el acceso a banda ancha varía, optimizaciones como edge computing en 5G reducen latencia, haciendo accesible estas tecnologías sin comprometer seguridad.

Desafíos Técnicos en la Implementación Escalable

Escalar filtros AR a millones de usuarios requiere arquitectura distribuida. Plataformas utilizan microservicios en Kubernetes para manejar picos de tráfico, con balanceo de carga basado en IA predictiva. Un reto clave es la compatibilidad cross-platform: filtros desarrollados en Unity deben adaptarse a WebGL para browsers, manteniendo precisión en detección mediante transfer learning de modelos preentrenados como MediaPipe de Google.

En términos de sostenibilidad, el consumo energético de AR en móviles es alto; técnicas como model pruning reducen parámetros en redes neuronales, bajando huella de carbono. Para ciberseguridad, se implementan zero-trust models, verificando cada request AR con tokens JWT, previniendo accesos no autorizados a datos de usuario.

- Escalabilidad: Uso de CDN para assets AR estáticos.

- Optimización: Quantization de modelos IA para dispositivos low-end.

- Seguridad: Integración de WAF (Web Application Firewalls) en pipelines AR.

Estos desafíos subrayan la necesidad de estándares abiertos, como los propuestos por el AR Alliance, para interoperabilidad segura entre plataformas.

Perspectivas Futuras: Integración con IA Avanzada y Blockchain

El futuro de filtros AR post-therians involucra IA multimodal y metaversos. Modelos como CLIP de OpenAI permiten filtros contextuales, donde un “gato” responde a comandos de voz mediante NLP (Natural Language Processing). En blockchain, avatares AR tokenizados como ERC-721 permiten comercio seguro, con oráculos verificando interacciones reales para prevenir fraudes.

En ciberseguridad, quantum-resistant cryptography protegerá datos biométricos contra amenazas futuras. Para Latinoamérica, iniciativas como las de la OEA promueven alfabetización digital en AR, mitigando riesgos en regiones con alta penetración de redes sociales.

Esta trayectoria técnica no solo entretiene, sino que redefine identidades digitales, exigiendo equilibrio entre innovación y protección.

Consideraciones Finales

Los filtros de realidad aumentada en redes sociales representan un pilar en la evolución de tecnologías emergentes, fusionando IA, visión por computadora y ciberseguridad. Su impacto trasciende el entretenimiento, influyendo en privacidad, identidades híbridas y arquitecturas seguras. Al avanzar, es imperativo priorizar estándares éticos y técnicos para un ecosistema digital inclusivo y resiliente, preparando el terreno para innovaciones responsables en un mundo interconectado.

Para más información visita la Fuente original.