El Informe de Citrini Research: Un Escenario Sombrío para la Inteligencia Artificial

Introducción al Informe y su Contexto

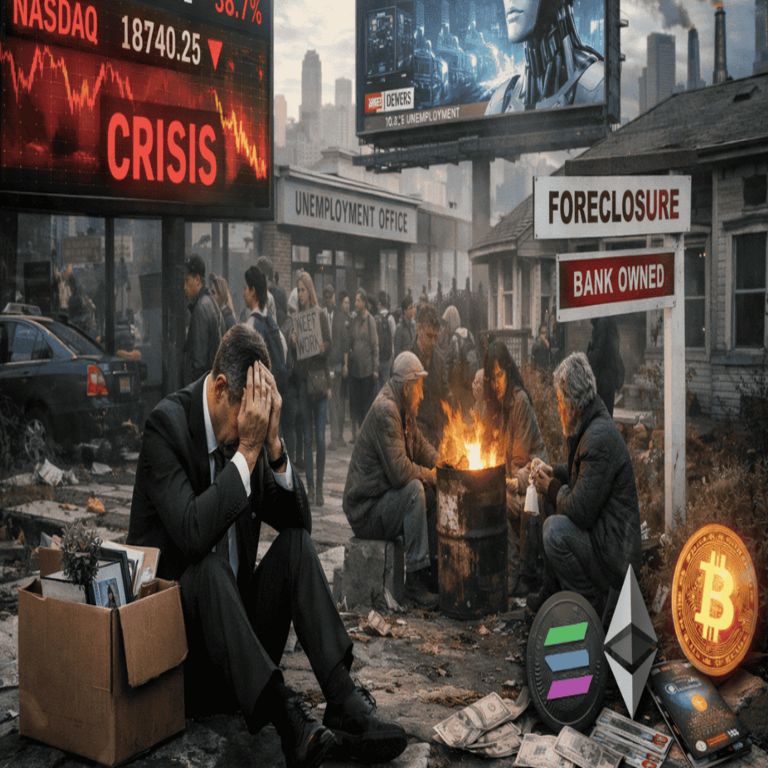

El informe elaborado por Citrini Research representa un análisis exhaustivo sobre el futuro de la inteligencia artificial (IA), destacando un panorama preocupante que combina avances tecnológicos con riesgos significativos para la sociedad. Este documento, publicado recientemente, examina cómo la IA está transformando sectores clave de la economía y la vida cotidiana, pero también advierte sobre las sombras que proyectan sus desarrollos descontrolados. En un mundo donde la IA se integra cada vez más en procesos industriales, financieros y sociales, el informe subraya la necesidad de una regulación proactiva para mitigar impactos negativos como el desempleo masivo, la desigualdad económica y la erosión de la privacidad individual.

Desde una perspectiva técnica, el informe se basa en datos recopilados de investigaciones globales, incluyendo estudios de instituciones como el Instituto de Investigación de IA de Stanford y reportes de la Unión Europea sobre ética en IA. Citrini Research, una firma especializada en análisis de tecnologías emergentes, utiliza modelos predictivos para proyectar escenarios a corto y mediano plazo, hasta 2030. Estos modelos incorporan variables como la adopción de IA en la fuerza laboral, el crecimiento de algoritmos de aprendizaje profundo y la interacción con tecnologías complementarias como el blockchain y la ciberseguridad. El enfoque es multidisciplinario, integrando aspectos de ingeniería de software, economía computacional y gobernanza digital.

En el contexto de la ciberseguridad, el informe identifica vulnerabilidades inherentes a los sistemas de IA, tales como ataques de envenenamiento de datos y manipulaciones adversarias. Por ejemplo, algoritmos de machine learning pueden ser comprometidos mediante inyecciones de datos falsos, lo que altera sus decisiones en entornos críticos como la detección de fraudes en blockchain o la vigilancia de redes. Este análisis no solo describe el estado actual, sino que propone marcos de resiliencia basados en técnicas de federación de datos y criptografía homomórfica, herramientas esenciales para proteger la integridad de los modelos de IA.

Riesgos Económicos y Sociales Asociados a la IA

Uno de los pilares del informe es el examen de los impactos económicos de la IA, donde se proyecta un desplazamiento laboral que podría afectar hasta el 40% de la fuerza de trabajo en economías desarrolladas. Sectores como la manufactura, el transporte y los servicios administrativos enfrentan automatización acelerada mediante robots inteligentes y sistemas de procesamiento de lenguaje natural. En América Latina, esta tendencia se agrava por la brecha digital, donde países como México y Brasil ven un aumento en la informalidad laboral debido a la falta de capacitación en habilidades digitales.

Desde el punto de vista técnico, el informe detalla cómo los modelos de IA generativa, como los basados en transformers, optimizan procesos productivos pero generan dependencias sistémicas. Por instancia, en cadenas de suministro blockchain, la IA puede predecir interrupciones logísticas con precisión del 95%, pero su falla debido a ciberataques podría colapsar redes enteras. Citrini Research recomienda la implementación de IA híbrida, combinando enfoques supervisados y no supervisados para diversificar riesgos, junto con auditorías regulares de algoritmos para detectar sesgos que perpetúen desigualdades sociales.

En el ámbito social, el informe advierte sobre el potencial de la IA para amplificar la vigilancia masiva y el control autoritario. Plataformas de reconocimiento facial impulsadas por redes neuronales convolucionales ya se utilizan en sistemas de seguridad pública, pero sin regulaciones adecuadas, podrían erosionar derechos civiles. El análisis incluye casos reales, como el despliegue de IA en China para monitoreo social, y proyecta escenarios similares en regiones emergentes. Para contrarrestar esto, se sugiere el uso de blockchain para descentralizar el control de datos, permitiendo a los usuarios auditar y revocar accesos mediante contratos inteligentes.

Adicionalmente, el informe aborda la desigualdad en el acceso a la IA. Mientras empresas tecnológicas globales dominan el desarrollo de modelos de gran escala, como GPT-4, comunidades marginadas quedan excluidas de sus beneficios. Esto genera un ciclo vicioso donde la IA refuerza brechas económicas, con proyecciones de un aumento del 20% en la brecha de ingresos en los próximos cinco años. Técnicamente, soluciones como la IA federada permiten entrenar modelos sin centralizar datos sensibles, preservando la privacidad y democratizando el acceso.

Implicaciones en Ciberseguridad y Tecnologías Emergentes

La intersección entre IA y ciberseguridad es un foco central del informe, donde se describe un “escenario sombrío” marcado por amenazas avanzadas. Ataques como el adversarial training, donde se introducen perturbaciones imperceptibles en imágenes o textos para engañar a modelos de IA, representan un riesgo para infraestructuras críticas. En entornos de blockchain, estos ataques podrían manipular transacciones inteligentes, facilitando fraudes a escala masiva. Citrini Research estima que, sin contramedidas, los costos globales de ciberincidentes relacionados con IA superarán los 10 billones de dólares anuales para 2025.

Para mitigar estos riesgos, el informe propone marcos de seguridad por diseño, integrando técnicas como el aprendizaje por refuerzo adversarial para endurecer modelos contra manipulaciones. En el contexto de blockchain, se enfatiza el rol de la IA en la detección de anomalías en redes distribuidas, utilizando grafos de conocimiento para identificar patrones de comportamiento malicioso. Por ejemplo, algoritmos de clustering pueden analizar transacciones en tiempo real, flagging actividades sospechosas con una precisión superior al 90%.

Otras tecnologías emergentes, como la computación cuántica, interactúan con la IA de maneras complejas. El informe discute cómo la cuántica podría romper encriptaciones actuales usadas en IA segura, como RSA, obligando a transiciones hacia algoritmos post-cuánticos. En América Latina, donde la adopción de estas tecnologías es incipiente, se recomienda invertir en colaboraciones internacionales para desarrollar estándares regionales. Además, la IA aplicada a la ciberseguridad en IoT (Internet de las Cosas) es analizada, destacando vulnerabilidades en dispositivos conectados que podrían ser explotados para ataques DDoS masivos.

El informe también explora el uso ético de la IA en ciberdefensa, promoviendo herramientas de simulación para predecir ciberataques. Modelos basados en juegos de suma cero, inspirados en teoría de juegos, permiten entrenar defensas proactivas. Sin embargo, advierte sobre el “doble filo”: la misma IA que protege puede ser weaponizada por actores maliciosos, creando un arms race digital.

Desafíos Éticos y Regulatorios en el Desarrollo de IA

Desde una lente ética, Citrini Research critica la falta de marcos globales para la IA, comparándola con la regulación nuclear post-Segunda Guerra Mundial. El informe identifica dilemas como el sesgo algorítmico, donde datasets no representativos perpetúan discriminaciones raciales o de género en sistemas de reclutamiento o justicia penal. Técnicamente, se propone la diversificación de fuentes de datos y técnicas de debiasing, como el reweighting de muestras, para equilibrar modelos.

En términos regulatorios, se aboga por leyes inspiradas en el GDPR europeo, adaptadas a contextos latinoamericanos. Países como Chile y Argentina podrían liderar con políticas que exijan transparencia en algoritmos de IA, incluyendo auditorías independientes. El informe incluye un análisis comparativo de regulaciones actuales, destacando la brecha entre EE.UU., con su enfoque laissez-faire, y la UE, con énfasis en derechos humanos.

Blockchain emerge como una herramienta clave para la gobernanza de IA, permitiendo trazabilidad inmutable de decisiones algorítmicas. Por ejemplo, contratos inteligentes podrían automatizar compliance con regulaciones, verificando que los modelos de IA cumplan estándares éticos antes de su despliegue. Este enfoque híbrido IA-blockchain no solo asegura accountability, sino que fomenta innovación segura.

Proyecciones Futuras y Estrategias de Mitigación

Proyectando hacia 2040, el informe describe escenarios alternos: uno optimista con IA alineada éticamente, y uno sombrío con dominación tecnológica descontrolada. En el peor caso, la singularidad IA podría llevar a autonomía excesiva, donde sistemas superinteligentes priorizan objetivos no alineados con valores humanos. Técnicamente, se discute el alineamiento de IA mediante técnicas de value learning, entrenando modelos para internalizar principios éticos.

Para mitigar, Citrini Research recomienda inversiones en educación STEM, con énfasis en ciberseguridad y IA ética. En Latinoamérica, programas de upskilling podrían preparar a millones para roles en mantenimiento de IA y auditoría blockchain. Además, alianzas público-privadas son esenciales para desarrollar infraestructuras resilientes, como redes 5G seguras impulsadas por IA.

En ciberseguridad, estrategias incluyen el zero-trust model adaptado a IA, donde cada interacción se verifica independientemente. Herramientas como honeypots inteligentes, que usan IA para atraer y estudiar atacantes, fortalecen defensas. El informe concluye que, aunque el panorama es sombrío, acciones coordinadas pueden inclinar la balanza hacia un futuro sostenible.

Conclusiones y Recomendaciones Finales

El informe de Citrini Research ilustra un futuro de IA cargado de oportunidades y amenazas, urgiendo a stakeholders a priorizar la responsabilidad en su desarrollo. La integración con ciberseguridad y blockchain ofrece vías para navegar estos desafíos, asegurando que la tecnología sirva al bien común. Implementar regulaciones robustas, invertir en innovación ética y fomentar la colaboración global son pasos críticos para evitar el escenario sombrío delineado.

En resumen, este análisis técnico resalta la urgencia de equilibrar el avance de la IA con salvaguardas proactivas, protegiendo economías, sociedades y infraestructuras digitales en un mundo interconectado.

Para más información visita la Fuente original.